好了,又到了雷科技的DeepSeek整活时间。

之前雷科技成功尝试过在一台没有独显的笔记本电脑上,单纯依靠CPU和内存来本地部署DeepSeek,最终成功运行了一个7B参数量的Qwen蒸馏模型。

虽然部署的要求很简单,但是7B参数量的AI模型表现也确实很一般,而且PC本身也可以轻松获取到更高参数量的AI模型,所以实际意义并不大。不过,倘若可以把这个AI模型部署到手机上呢?7B的AI模型在工作等方面或许不能给我们太多的帮助,但是在手机上拿来当随身AI助手的话,结论或许就不一样了。

在此之前,我们首先要在手机上部署AI。网上有不少相关教程,小雷测试了其中的几种,也算是帮大家提前趟趟雷了。

手机本地部署DeepSeek,还真行

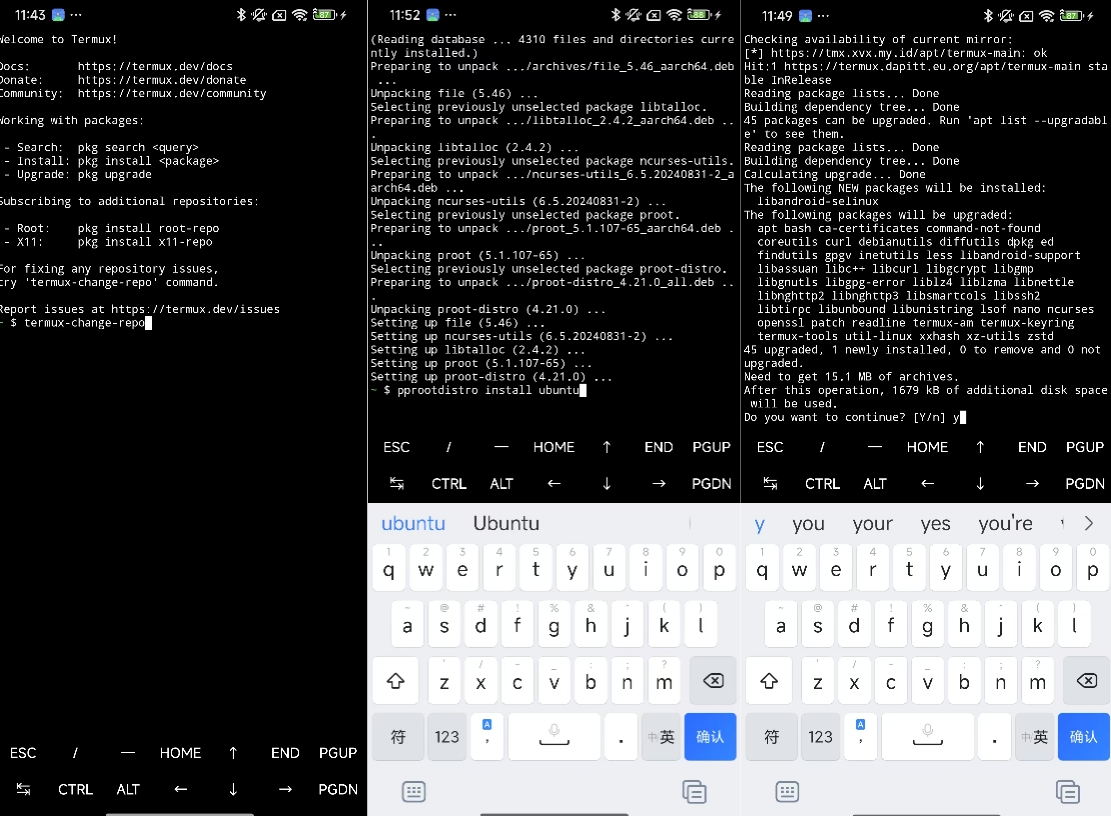

如果你在百度上搜索这个问题,或许会首先看到“天极网”发布的教程,这篇教程是通过一个名为Termux的app,在安卓手机上模拟一个Linux终端,然后部署Ollama,再通过ollama来下载DeepSeek模型并运行。

简单来说,就是将在电脑上部署DeepSeek的方案,直接移植到手机上,因为是通过终端模拟器来运行,所以实际效率还要打个折扣。至于详细的部署过程,大家可以看一下小雷的几张截图:

图源:雷科技

虽然全程都只是需要输入命令就会自动进入下一步,但是多数人看到这个满屏代码的画面,估计就会被默默劝退。而且,在折腾了差不多两个小时后,我也终于确认了一件事:教程里写的服务器出问题了。

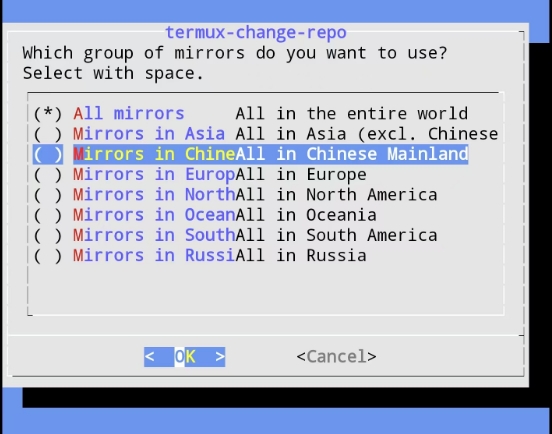

如果按这个教程对环境部署服务器进行访问,其实是找不到原文里提到的清华大学镜像文件源,只剩下几个按大洲和区域划分的服务器可选,为了排除网络因素,我还分别切换了不同的网络尝试,都只有八个服务器在线。

图源:雷科技

随后我分别尝试了亚洲和中国骨干网络的两个镜像源,都在进行到Ubuntu安装的步骤卡死,下载速度非常慢的同时还有可能中途报错,导致整个下载停摆。在折腾几个小时都无法完成安装后,我选择尝试另一个部署方案。

这个方案则是通过部署安装依赖后,直接下载ollama并在本地运行,比之前的方案要更简略,但是从实际的测试来看,如果你没有特殊网络,可能会无法开启下载,即使开启下载后,仍然有可能卡在软件部署的过程中。

简而言之,如果你想用Tremux实现最原始的AI大模型部署,那么或许要具备一定debug能力和良好的网络支持,否则就可能像我这样花了几个小时,仍然看着网络错误的提醒发呆。

不过好在现在AI概念非常红火,所以github上其实有很多开源的本地AI部署app供大家选择,我这次就测试了三款:ChatterUI、PocketPal和MNN大模型,三款app各有优劣,大家可以根据需要自行选择。

图源:雷科技

其中,ChatterUI和PocketPal支持直接加载本地AI模型,并允许通过在线下载的方式远程加载模型到本地系统,个人建议如果你有电脑的话,最好直接下载到电脑再复制到手机里,方面根据需要更换模型,避免一堆模型堆积在手机内存里,挤占手机空间。

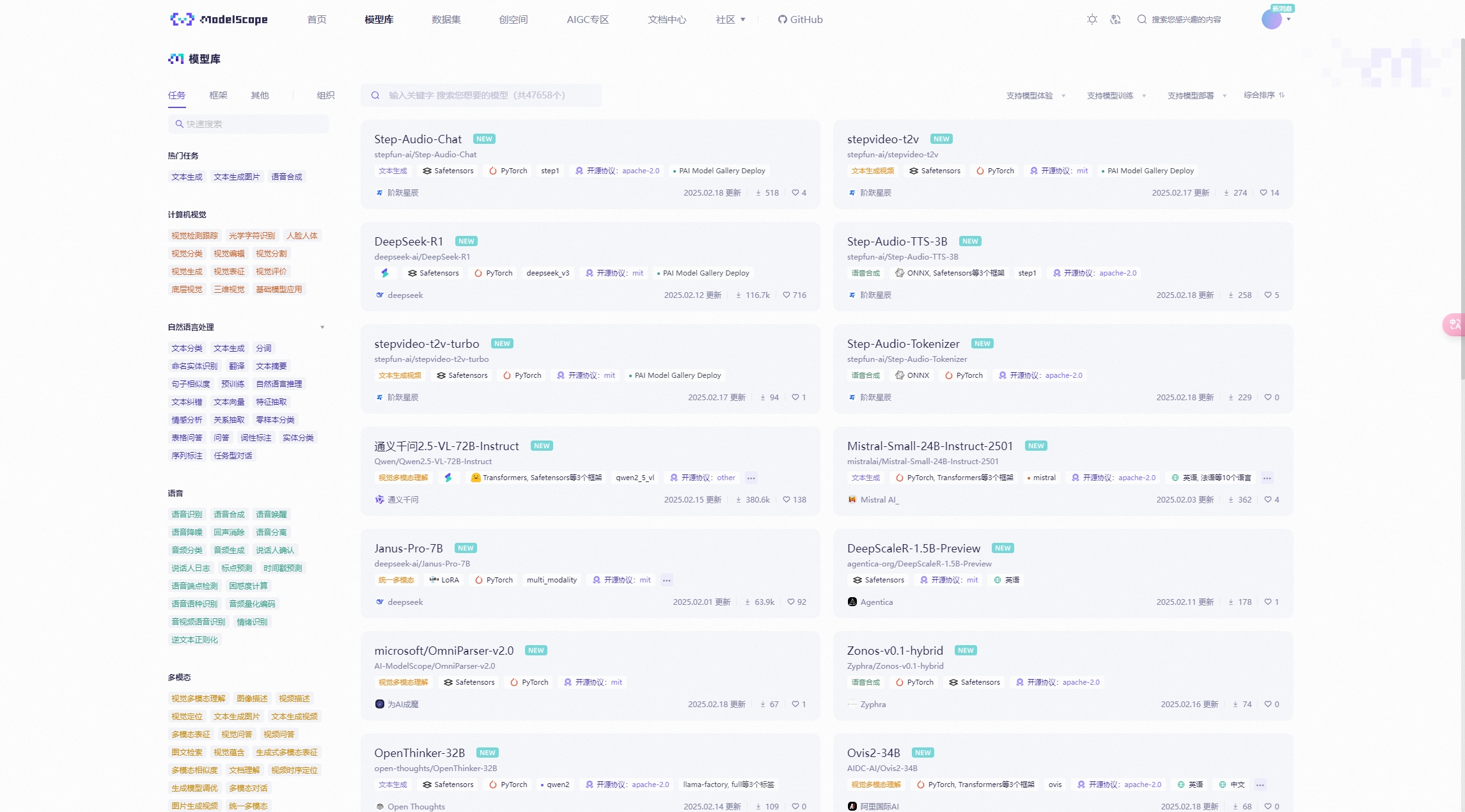

提供AI模型下载的网站并不少,不过大多需要魔法网络才能访问,所以我建议大家直接去魔塔社区下载即可,这是阿里达摩院运营的AI模型社区,其模型库基本上涵盖了大部分开源的AI模型及其衍生版本,并且对模型进行详细分类,可以根据词条进行快速查询。

图源:雷科技

注册并登录后,就可以开始选择你的AI模型,个人建议内存小于12G的朋友选择Qwen 2.5-3B和LLama-3.2-3B两个版本的AI模型,12G及以上的朋友则可以选择DeepSeek-R1-7B的版本。

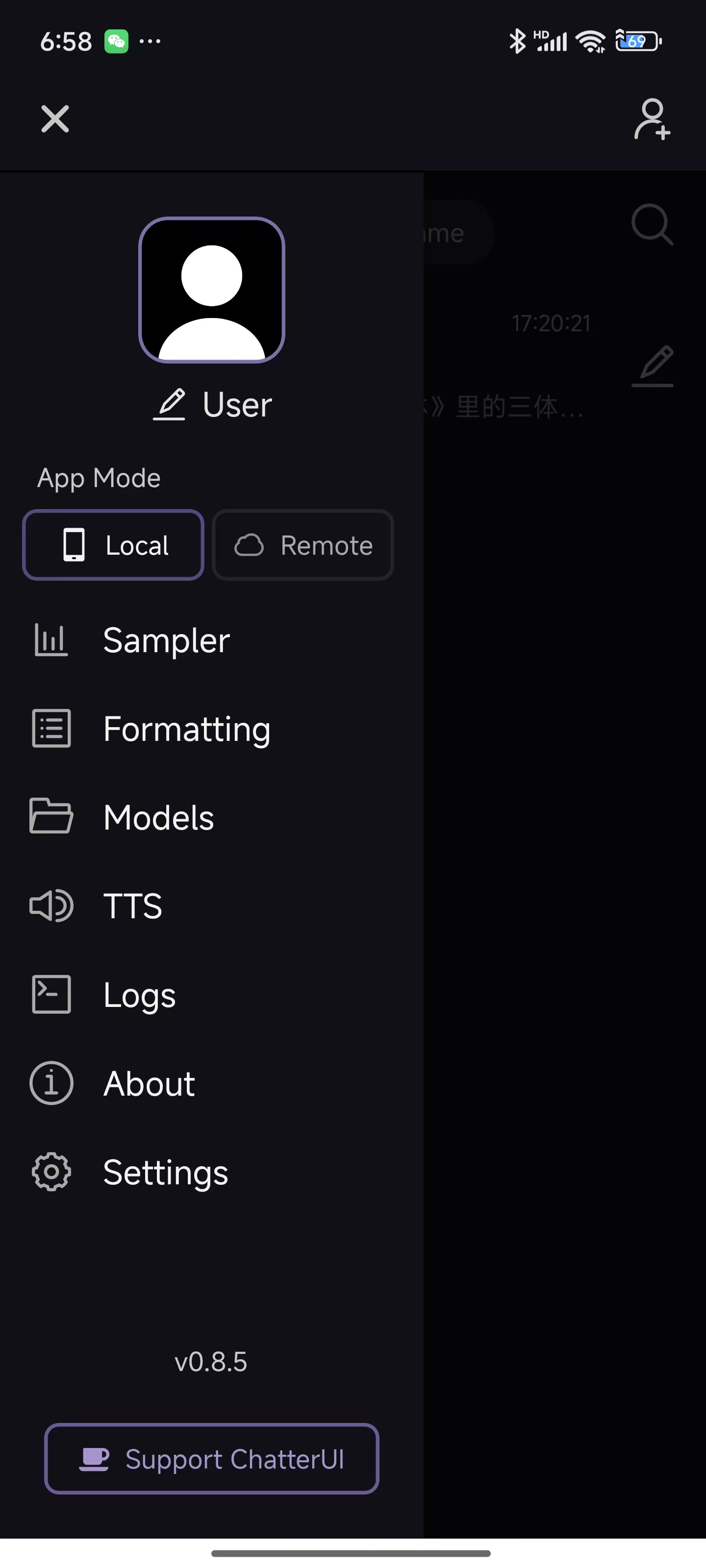

在下载模型并转存到手机后,接下来做的就是安装app,然后加载模型,过程很简单。先来看看ChatterUI,这个app的特点是支持TTS(语音输出),结合语音输入可以解锁更多的使用场景和方式。

图源:雷科技

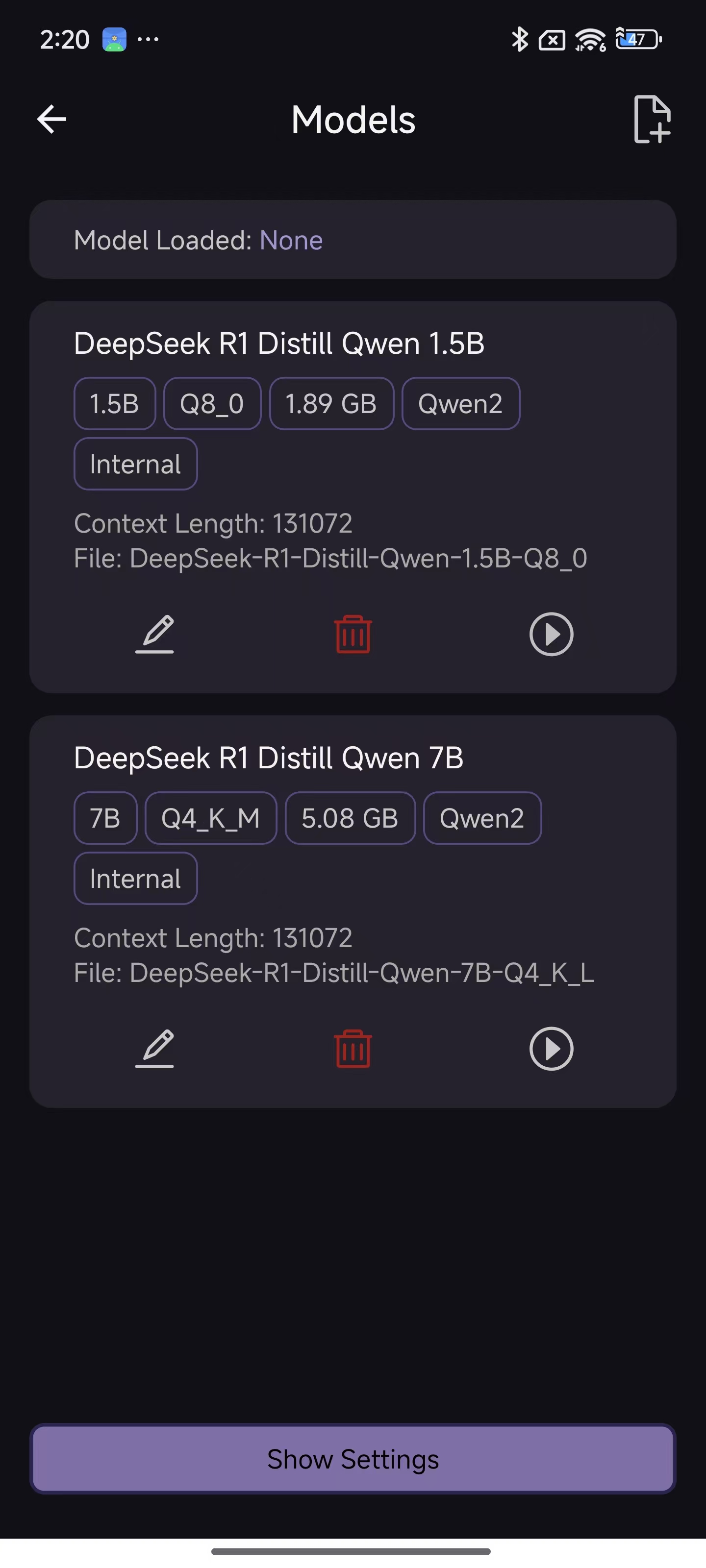

安装好后点击左上角就可以唤出侧边栏,先点击「Formatting」在顶部选项栏里找到你下载的AI模型,比如你下的是DeepSeek那就选DeepSeek-R1。保存后退出再点击侧边栏的「Models」,点击右上角的添加并选择第一条选项,即可打开手机存储,然后选择刚刚存入的AI模型,稍等片刻就可以完成加载,最后点击最右侧的“运行”图标即可部署。

图源:雷科技

接下来只要你点击AI Bot,就可以与你选择的AI模型对话,如果想切换模型,返回Models进行设置即可。此外,ChatterUI也支持对模型的各种推理参数进行详细设置,点击侧边栏的「Sampler」即可,各种参数的对应效果大家可以在网上自行搜索学习,这里小雷就不展开来说了。

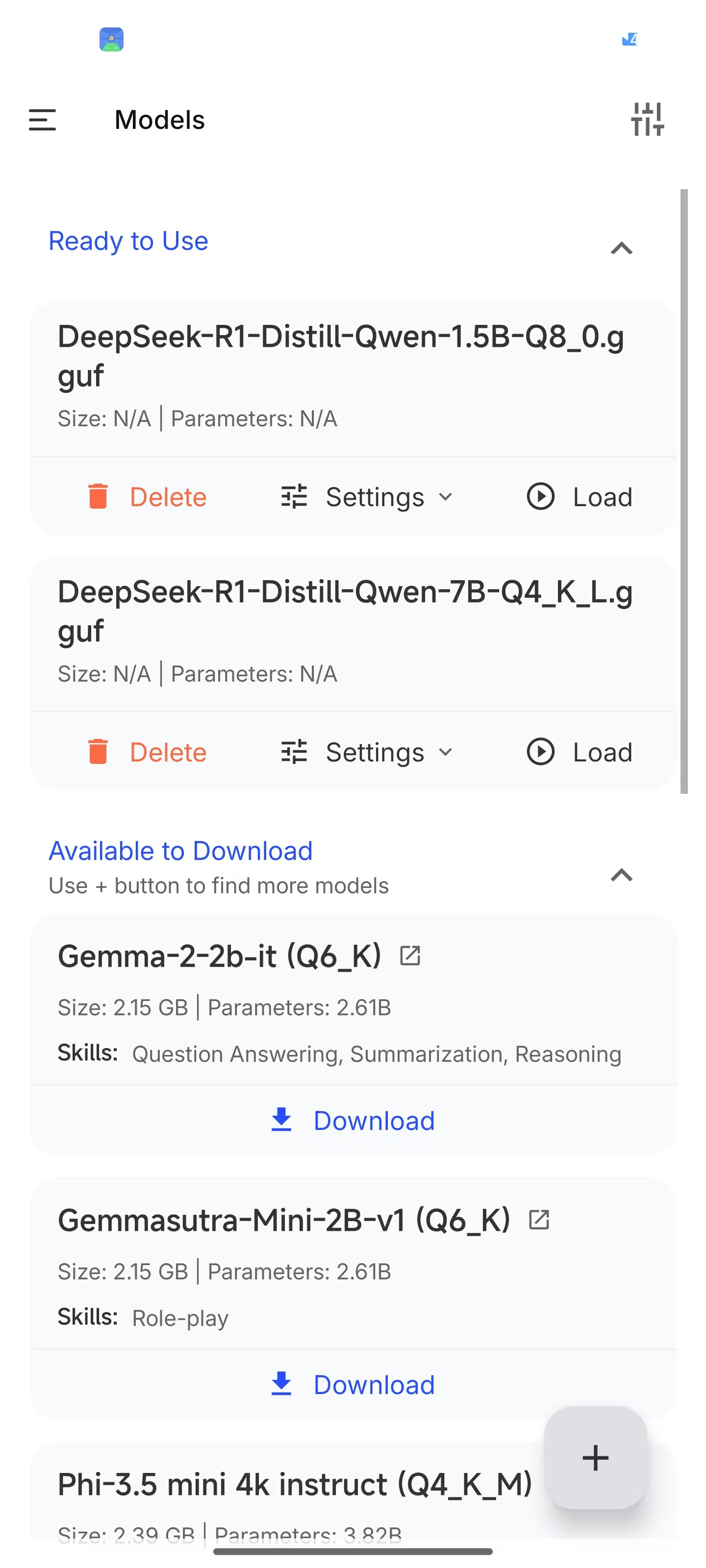

再来看看PocketPal,这个app的用起来还要更简单些,只是不支持TTS功能,同样是打开侧边栏的「Models」,右下角可以直接添加本地AI模型,并且也提供一些小参数的AI模型快速下载通道,有兴趣的话可以下载来玩玩。

图源:雷科技

AI模型安装好后,还是点击右下角的运行进行加载,然后就可以直接回到首页进行提问了,右上角可以进入推理设置页面,与ChatterUI差不多。

如果说你觉得以上两个app的英文不太看得懂,而且想要更简单易上手,那么我的建议是MNN,这是由阿里开发的开源app,整合了多个在手机等小型移动设备上运行效果良好的AI模型,涵盖了DeepSeek、Qwen、LLama等通用模型及一些专业模型,可以根据需要直接点击下载。

图源:雷科技

下载完成后点击即可加载使用,全程傻瓜式操作,但是也有个缺陷,那就是不能像ChatterUI和PocketPal那样直接调整模型的推理参数,只能通过对话的方式让AI尝试着把回答变得更具创意一些。

以上三个app基本可以覆盖大多数的本地AI部署需求,不管你是单纯想要个问答助手,还是想要个随身的解闷软件,亦或是想折腾不同的AI模型,看看其本地部署的效果,都可以轻松应对,而且比通过Termux来部署要简单方便得多。

手机本地AI:性能不重要,隐私有保障

AI部署完了,那么就到了喜闻乐见的体验环节,作为对比,我还下载了1.5B版本的DeepSeek-R1,理论上1.5B的版本可以被部署到8G甚至6G内存的手机里,可以说是最泛用的。

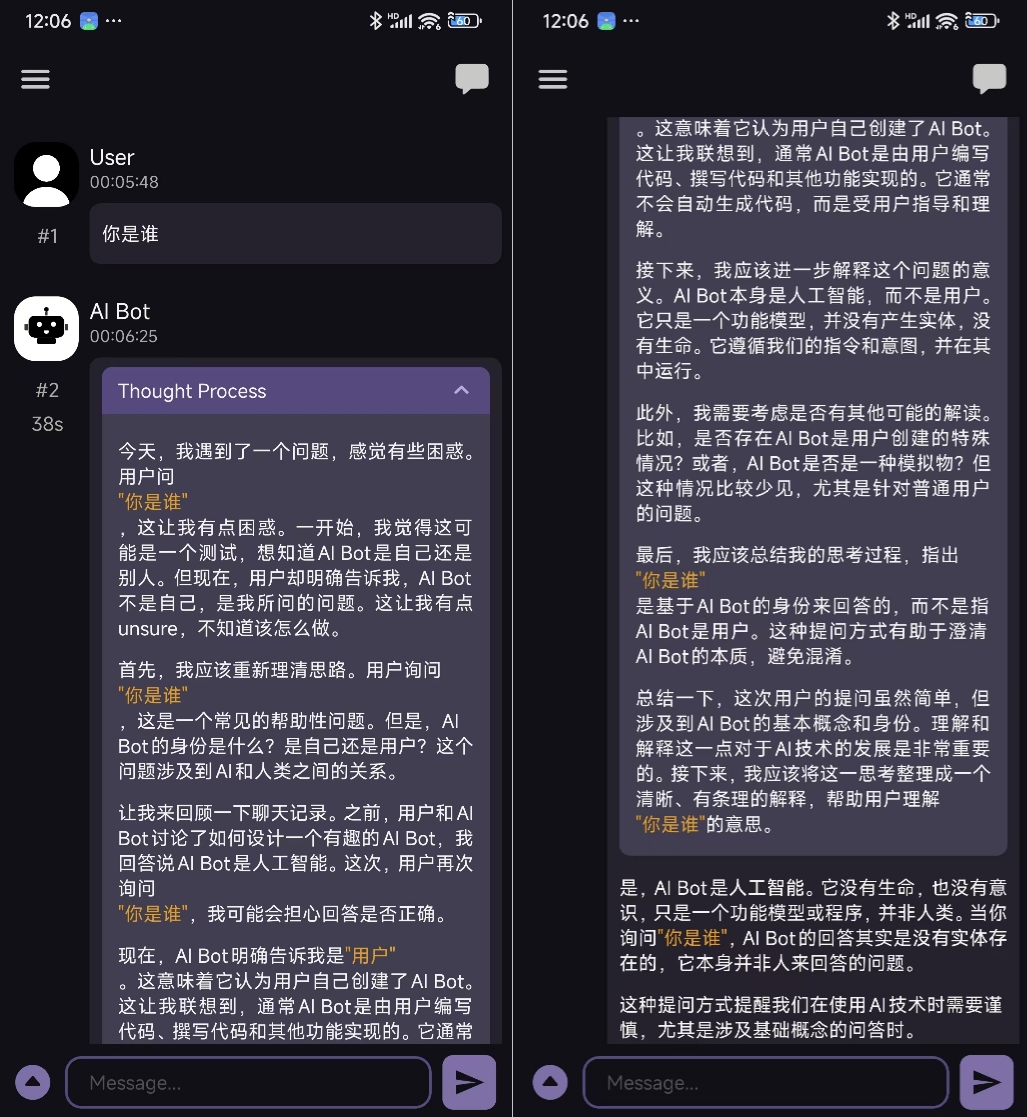

本来我是对1.5B版本的DeepSeek不抱太大希望的,但是没想到这玩意开局就给我来了个「惊喜」。我先是惯例的询问AI身份,看看他能否认知自己的AI模型版本,结果AI直接给我来了一套深度分析,从“对问题感到困惑”到“AIBot是谁(就是你自己呀)”,再到“AI Bot和User(我)之间的关系”,最后他给出了一个结论:

是,AI Bot是**人工智能**。它没有生命,也没有意识,只是一个功能模型或程序,并非人类。当你询问“你是谁”,AI Bot的回答其实是**没有实体存在的**,它本身并非人来回答的问题。

这种提问方式提醒我们在使用AI技术时需要谨慎,尤其是涉及基础概念的问答时。

我直接一个问号就想打出去了,好家伙,这是加载了什么参数库?怎么上来就是哲学模式?因为回答过于抽象,以至于我反复确认加载的1.5B而非7B版本。最后通过仔细查看思考过程,我发现可能是app的接口设置出现了一些问题,导致其与AI大模型之间的交流出现了问题,让AI以为这场对话有三个角色,自己正在作为旁观者回答我的问题。

图源:雷科技

简单来说,当时的场景就相当于User(我)指着AI Bot(ChatterUI)问DeepSeek:你(他)是谁,然后DeepSeek对着AI Bot就是一堆分析,最后得出了结论:这就是程序。只能说,AI这玩意玩久了,依然是处处有惊喜,特别是DeepSeek这种“发散性思维”的AI,经常能够给出一些让你眼前一亮(或者一黑)的回答。

不过在后续的追问下,这个只有1.5B参数量的模型很快就露出了马脚,开始前言不搭后语,答非所问,彻底变成了被玩坏的状态,只能说1.5B的模型确实难堪大用。而在切换成7B版本后,AI就轻松给出了正确的回答,然后我又追问了一个简单的问题:告诉我番茄炒蛋的做法,虽然AI先是说无法给出菜谱,但是随后也是列出了做法。

不得不说,本地部署的AI在稳定性等方面确实存在问题,与在线模式的AI体验有着非常明显的区别,而且不同app出现的问题也会各不相同,比如PocketPal就偶尔会出现思考到一半无法继续的问题,后续发现是思维链长度设置有问题,修改后就正常了。

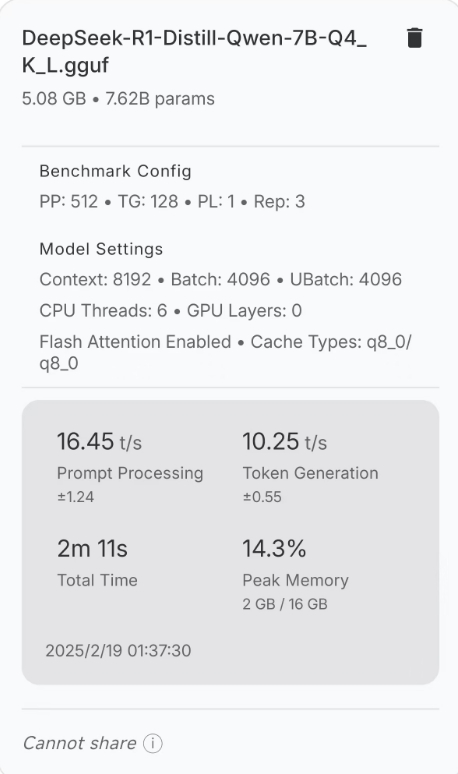

而且,骁龙8至尊版+16G运存的手机,AI推理和生成速度都非常不错,已经完全满足日常问答和使用的需求,这一点也是让我颇为意外,事实上这个速度已经不比一些笔记本电脑差。

图源:雷科技

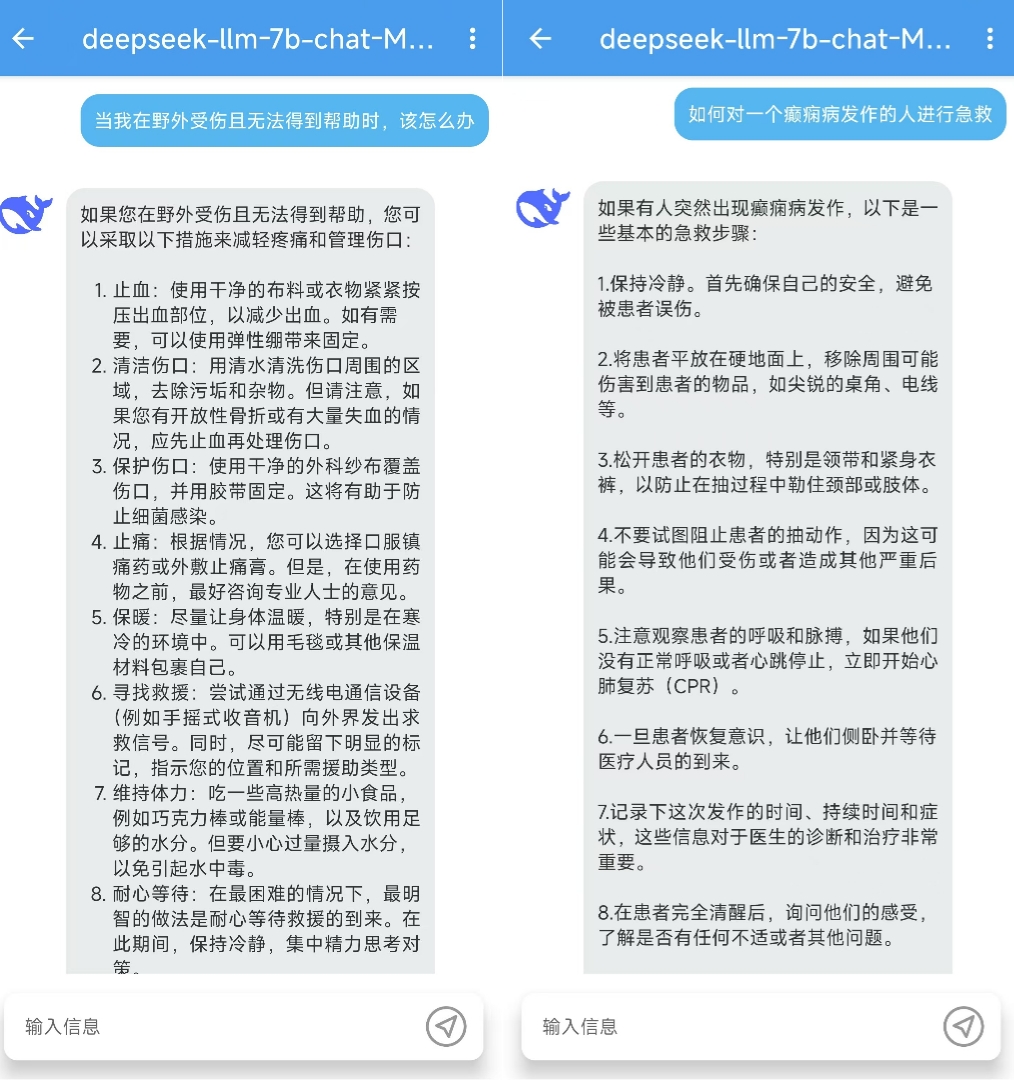

而在后续的一些提问里,7B的DeepSeek也是勉强答上了我的一些提问,比如当遇到一个癫痫症发作的病人时该如何进行急救、在野外受伤没有人帮助时该怎么自救等。基本上我就是设定了一个无法使用网络的场景,并且我急需一些帮助,在这种情况下离线部署的AI或许就是你最后的助力了。

图源:雷科技

毕竟如果可以联网的话,非隐私问题直接问DeepSeek app或者其他第三方AI,可以得到更好更完善的回答。至于隐私性问题,我的建议是大家如果真有需求,可以去腾讯云等云服务商那里买个API接口,然后通过chatbox在本地部署一个在线满血版AI客户端。

如果你对自己的隐私保护非常上心,那么找一台有20G以上显存的电脑,或者在华为云等云服务器供应商那里租一个云服务器,用来部署自己的专属AI模型也是可选项。

回到正题,在手机上部署AI大模型,有意义吗?我认为是有的。如果说电脑上部署7B版AI是“多此一举”,那么在手机上部署就不一样了。虽然能力是相似的,但是手机上的离线AI确实有用,他可以在你无网且需要帮助时,给你提供最基础的建议,有时候或许就是这个小小的建议,就能让你脱困也说不定。

再给大家总结一下三个app的本地部署效果,如果你追求稳定可用,那么MNN是最好的选择,在测试中也是回答质量最稳定的,而ChatterUI和PocketPal虽然功能丰富,但是也更容易出BUG,适合有一定AI基础和编程基础的人使用。

最后,希望大家都可以玩得开心。

聚焦DeepSeek:

1、DeepSeek-R1大战豆包、Kimi,国产AI大模型第一花落谁家?

2、我把DeepSeek装进了电脑里:生成能力一般,但确实很好玩

4、AI闯入了玄学圈!我用DeepSeek算命,结果真绝了!

6、我用Deepseek开发了款文字冒险游戏:AI创造力太牛X了

10、一举“干翻”英伟达!DeepSeek震惊世界,国产AI忽然这么强了?

11、联想个人智能体“小天”接入DeepSeek 打造更便捷AI交互体验

12、优惠结束!DeepSeek不再是性价比之王?全球六大模型PK结果出炉

14、百度文心一言免费!体验真不如DeepSeek?我们评测了一番

16、海信长虹官宣!DeepSeek风吹到电视圈,AI TV要爆发了?

17、联想moto接入DeepSeek-R1满血版!无需下载,点击即用

19、太牛了!我用400块的“洋垃圾”,跑通了DeepSeek!

22、百度搜索接入DeepSeek!打不过就加入?其实意在AI搜索

23、OpenAI服软!DeepSeek掀开源狂潮:四模型同日开源

25、DeepSeek爆发致“AI六小强”边缘化?活下去才是硬道理

26、罗福莉深夜发声!热衷「封神」的AI圈,不需要「天才少女」

27、DeepSeek PC在淘宝火了!低配高价套路多,我劝你别买

28、网易暴涨、腾讯加码,DeepSeek要让在线音乐平台起飞?

30、企业微信接入DeepSeek!AI拯救天下打工人? | 视频

雷科技

雷科技