两天前,知名 AR 厂商 Rokid 发布了新一代 AR 眼镜——Rokid Glasses,通过摄像头、多模态大模型以及(玻璃衍射)光波导等技术,在一定程度上让 AR 眼镜实现了对真实世界的感知与理解,以及对用户的协同与展现。

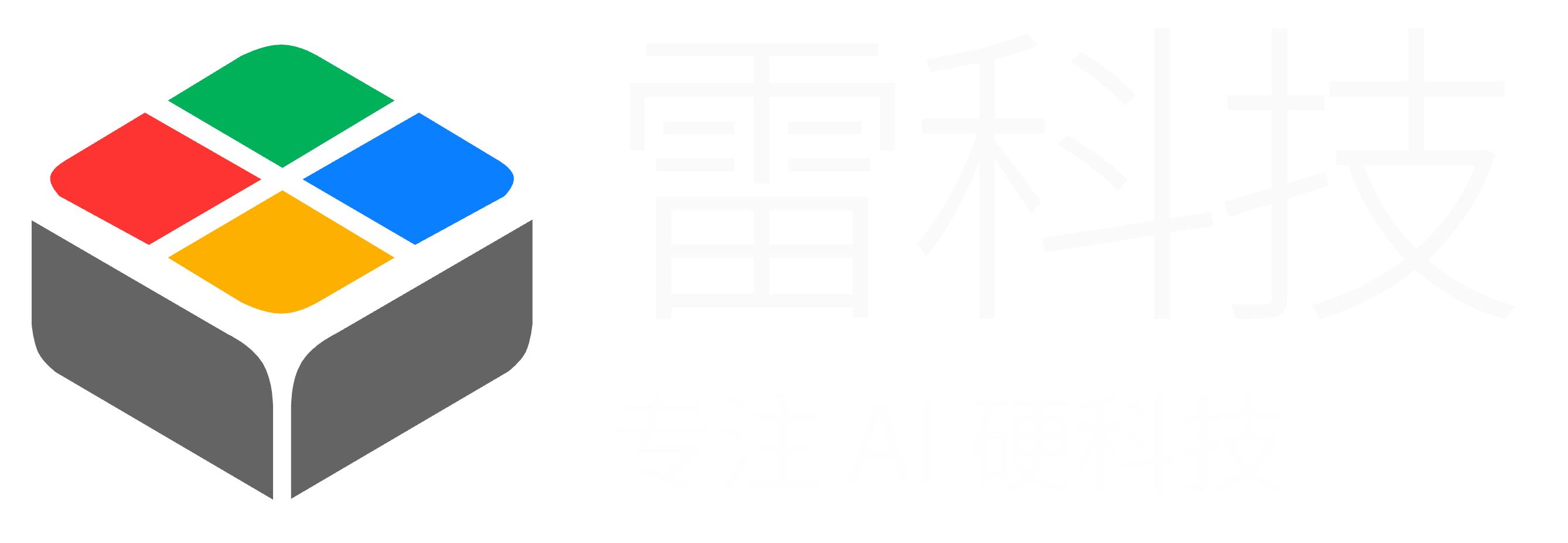

然而就当下来说,AI 或者说视觉大模型对真实世界的理解还远远不够,更多还是对二维照片的物体识别,很难像人类一样具备空间理解能力,也根本无法准确描述物体与物体、物体与人之间的空间关系。

而这个问题的答案,或许还是要从大模型技术中寻找解法。

稍早前,《Pokémon Go》开发商 Niantic 对外宣布正在开发「地理空间大模型」(Large Geospatial Model,简称 LGM),将利用大规模机器学习来理解真实世界的空间,借助 LGM 模型实现「空间智能」。

LGM 模型训练,图/ Niantic

用全球玩家数据打造的「地理空间大模型」

正如 Niantic 在新闻稿中提到的,即使是当今最先进的 AI 模型也难以可视化和推断场景中的缺失部分,或从新的角度想象一个地方。而在根本上,Niantic 认为借助大语言模型训练的方式,我们已经能让 AI 实现比拟甚至超越人类空间理解能力的「空间智能」。

野心背后,Niantic 的另一份底气在于,作为《Pokémon Go》《Ingress》开发商,Niantic 早就手握全球无数玩家贡献的海量真实影像和地图数据,并在过去五年中开发视觉定位系统 (VPS) ,在手机上实现根据单个图像在 3D 地图中确定用户的方位。

事实上,2021 年 Niantic 还发布过一项名为 ManyDepth 的技术,能够通过单个手机摄像头直接创建 3D 地图,利用机器学习将没有深度信息的二维图像转化为带有深度信息的三维图像,并且不依赖 LiDAR 或者其他深度传感器。

图/ Niantic

而作为 Niantic 视觉定位系统的一部分,LGM 模型目前已经训练了超过 5000 万个神经网络,拥有超过 150 万亿个参数,能够在超过 100 万个位置运行。Niantic 首席科学家 Victor Prisacariu 还表示:

「利用我们的用户在玩 Ingress 和 Pokémon Go 等游戏时上传的数据,我们打造了世界的高保真 3D 地图,其中包括 3D 几何形状(或事物的形状)和语义理解。」

最终,LGM 模型的目标是在全球范围内实现对地理空间的共同理解,即便是那些没有被玩家扫描过的地方。

但 LGM 模型意义不仅是让设备「看懂」真实环境,提供精准的空间定位。更重要的是,只有让计算机能够更准确、高效地感知和理解物理空间,才能更深刻地改变人与机器之间基于物理世界的交互方式,进而推动 AR 眼镜以及智能机器人真正走进我们的生活。

左边是 Rokid Glasses,右边是特斯拉擎天柱,图/ Rokid、特斯拉

不过具体到 AR 眼镜上,LGM 模型的推出真的会如人们期待的那样,加速 AR 眼镜的普及吗?甚至成为 AR 行业的「一脚地板油」?这不是一个容易解答的问题。

地理空间大模型,AR版的「高精地图」?

在 AR 眼镜中,准确的空间定位一直是重中之重,这一点相信早已不言而喻。问题在于,现行的 SLAM(同步定位与建图)空间定位技术就像一位即兴作画的画家:通过摄像头等传感器,实时描绘周围环境的地图并确定自身的位置。

但要用这种「即看即建」的方式实现准确的空间定位,不仅依赖传感器支持,往往还需要较高的性能与续航开销,对于内部空间「寸土寸金」的 AR 眼镜来说,始终是不小的压力。AR 厂商不是没想过新的解决方案,比如 Rokid AR Studio 上就实现了基于单目摄像头的空间定位和手势识别,也只是降低了硬件门槛和成本。

Rokid AR Studio,图/ Rokid

而与之相对,LGM 模型和 SLAM 技术可以理解为 AR 眼镜的「地图」和「指南针」:LGM 提供了一幅全局性的高精度地图,为设备提供宏观层面的环境理解;SLAM 则像指南针,帮助设备在未知或动态环境中快速调整和适应。

通过构建了一套全球性的高精度 3D 地图,LGM 模型能够提供详尽的地理空间信息。对于 AR 眼镜来说,这种预先构建的地图意味着在已知环境中无需从零开始建图,而是可以直接利用 LGM 提供的全局地图进行精准定位,理论上可以在不影响准确性的前提下,大幅削减性能开销,尤其在室外场景。

想象一下,当你在一个陌生的城市中寻找餐馆,AR 眼镜让导航箭头更准确地贴合地面,更精确地指向餐馆的入口,而不是像过去那样悬浮在半空,只能提供粗略的方向。这种视觉上的准确性不仅提高了便利性,也增强了用户对 AR 眼镜的信任感。

另一方面,LGM 模型对空间的「语义理解」,对于 AR 眼镜的意义不只是识别环境,还在于「理解」环境。与 SLAM 只是绘制几何地图不同,LGM 模型还能通过语义理解为空间中的物体赋予了具体意义,让 AR 眼镜能够理解环境的上下文,将虚拟的 3D 物体合理地放置在真实空间的方位中。

任天堂与 Niantic 合作的《皮克敏》AR 手游,图/ Niantic

这一点也与现有视觉模型依赖二维图像识别技术不同,视觉模型更多只能识别出眼前是「路」还是「树」,却无法理解这些物体在空间中的位置,自然也无从谈起虚拟内容在真实空间的合理放置。

不过众所周知,《Pokémon Go》并未进入中国,中国市场也始终没有出现一款能够进入大众视野的 AR+LBS 游戏。类似 LGM 的地理空间大模型,在中国还没有出现成长的土壤。

但视觉大模型其实也有潜力从二维平面的物体识别进化到三维空间的理解,具备「空间智能」,甚至是视频生成模型也有可能。就像 OpenAI Sora 出现之初,以 360 创始人周鸿祎为代表的一部分人都认为 Sora 不仅是视频生成模型,还是能够最终理解物理世界的「世界模型」。

Sora,图/ OpenAI

再有,Niantic 的 LGM 目前仍在开发中,理论上的潜力是一方面,实际上的表现则是另一方面,还很难断言它的未来。

AI大模型改变 AR 眼镜,一切才刚开始

在之前的报道,雷科技多次提到一个观点:最近一年多智能眼镜的关键转变在于大模型带来的自然理解能力大升级,带来了人机语音交互的质变,这是交互方式有限的智能眼镜能够爆发的前提条件。

这一点对于 AR 眼镜其实亦然。虽然包括 Rokid、雷鸟创新都在尝试各种交互方式,比如 Rokid 基于单目摄像头的手势交互,雷鸟创新基于智能戒指的交互,但实际上主流产品线受限于性能、体验和成本等因素,语音和触摸交互,才是核心的交互方式。

雷鸟 X2,图/雷鸟创新

从这个角度看,AI 语音交互带来的质变也就不言自明了,可以明显改善 AR 眼镜在人机交互方式上的短板。而与此同时,大模型也在带来计算机视觉能力上的「基因突变」,决定着 AR 眼镜的未来方向。

诚然,目前 AI 视觉的价值才刚刚崭露头脚,比如基于周围环境的实时问答、直接翻译外文进行播报或文本呈现等,都能做到比以往更低的成本、更好的体验。另外,地理空间大模型、能够理解世界的视频生成模型,对于 AR 眼镜来说也还未真正达到可用。

但不管从交互体验,还是 AR 眼镜的「减重」来看,基于摄像头的 AI 视觉(端云混合)在理论上都有更高的潜力,不仅能降低空间交互的复杂度和门槛,也能减少传感器和传统计算开销,从而做到重量和成本的降低、续航的提升。

一言以蔽之,大模型改变 AR 眼镜的旅程,还远没有走到终点。

雷科技

雷科技